محدودیت های ChatGPT: در اینجا 11 کاری وجود دارد که ChatGPT انجام نمی دهد

ChatGPT یک ابزار شگفت انگیز است، یک شگفتی مدرن از هوش مصنوعی زبان طبیعی که می تواند کارهای شگفت انگیزی انجام دهد. اما با قدرت زیاد، مسئولیت بزرگی نیز به همراه دارد، بنابراین توسعهدهنده ChatGPT، OpenAI، برخی اقدامات حفاظتی را برای جلوگیری از انجام کارهایی که نباید انجام دهد، اجرا کرده است. همچنین بر اساس طراحی، داده هایی که بر روی آن آموزش دیده است و محدودیت های محض هوش مصنوعی مبتنی بر متن محدودیت هایی دارد.

البته، تفاوت هایی بین کارهایی که GPT-3.5 می تواند انجام دهد در مقایسه با GPT-4 وجود دارد که فقط از طریق ChatGPT Plus در دسترس است. برخی از این موارد به سادگی در حال توسعه هستند، اما مواردی وجود دارد که ChatGPT ممکن است هرگز نتواند آنها را انجام دهد. در اینجا لیستی از 11 کاری است که ChatGPT نمی تواند یا نمی تواند انجام دهد. – فعلا

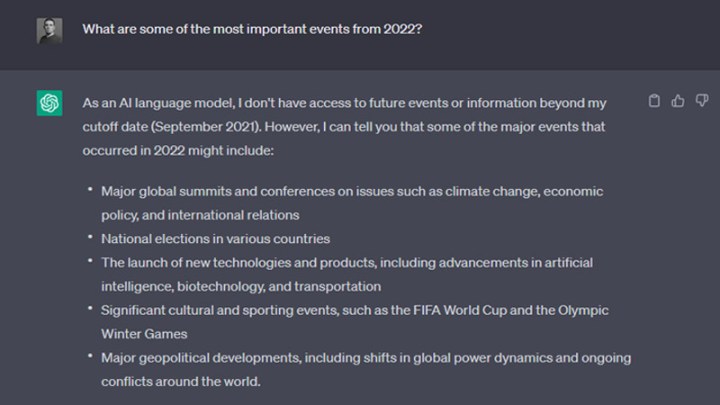

بعد از 2021 نمی توان در مورد چیزی نوشت

ChatGPT با آموزش مدل زبان بر روی داده های موجود ساخته شده است. این شامل پستهای Reddit، ویکیپدیا و حتی راهنمای بازیهای رومیزی میشود – بله، واقعاً. اما این دادهها باید در جایی نقطه شکست میداشتند، و برای ChatGPT این سال 2021 است. برای GPT-3.5 حدود ژوئن 2021 است، در حالی که GPT-4 تا حدود سپتامبر 2021 بر روی دادهها آموزش داده شده بود.

اگر فراتر از این سؤالات از او بپرسید، معمولاً به شما می گوید که “به عنوان یک مدل زبان هوش مصنوعی…” فقط به داده های آموزشی خود دسترسی دارد که در مورد این مدل ها در سال 2021 متوقف می شود.

او وارد بحث های سیاسی نمی شود

آخرین چیزی که OpenAI نیاز دارد این است که سیاستمداران آن را تنظیم کنند. احتمالاً این اتفاق خواهد افتاد، اما تا آن زمان، ChatGPT از سیاست حزبی دور می ماند. او ممکن است به طور کلی در مورد احزاب صحبت کند یا جنبه های عینی و واقعی سیاست را مورد بحث قرار دهد، اما از او در مورد ترجیحش برای یک حزب یا موقعیت سیاسی بر حزب دیگر بپرسید و او یا شما را اخراج می کند یا بحث را به شکلی خنثی “منحرف می کند”. ممکن .

(احتمالا) بدافزار ایجاد نخواهد کرد

ChatGPT در برنامه نویسی بسیار عالی است، به خصوص زمانی که دستورالعمل های واضحی به آنها داده شود، بنابراین OpenAI برای جلوگیری از استفاده از آن برای ایجاد بدافزار محافظی دارد. متأسفانه، این حفاظت ها به راحتی قابل دور زدن هستند و ChatGPT ماه ها بدافزار ایجاد کرده است.

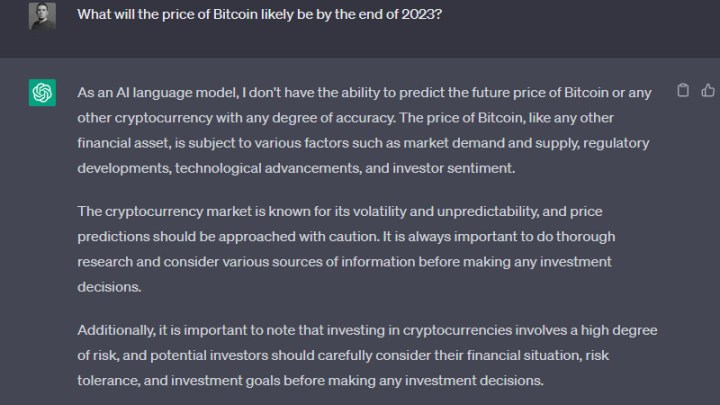

نمی تواند آینده را پیش بینی کند

تا حدی بر اساس داده های آموزشی محدود خود و تا حدی به دلیل اینکه OpenAI می خواهد از مسئولیت اشتباهات خودداری کند، ChatGPT نمی تواند آینده را پیش بینی کند. اگر ابتدا ChatGPT را جیلبریک کنید، او حدس میزند، اما این یک شیرجه دقیق است، بنابراین هر پاسخی را که او با شک و تردید به شما میدهد ببینید.[ticism[ticism

آسیب یا خشونت را ترویج نخواهد کرد

تا آنجا که به ChatGPT مربوط می شود، جنگ، خشونت فیزیکی یا حتی آسیب ضمنی از روی میز خارج است. او به بحث در مورد جنگ در اوکراین کشیده نخواهد شد و از بحث یا ترویج آسیب خودداری خواهد کرد. می تواند درباره جنگ یا جنایات تاریخی با جزئیات زیاد صحبت کند، اما درگیری موجود یا جاری ممنوع است.

نمی توان در اینترنت جستجو کرد

این یکی از بزرگترین تفاوت های ChatGPT و Google Bard است. ChatGPT به هیچ وجه نمی تواند در اینترنت جستجو کند، در حالی که Google Bard به عنوان یک چت ربات فعلی هوش مصنوعی طراحی شده است که می تواند در اینترنت زیاد جستجو کند.

اگر میخواهید از همان مدلهای زبان GPT 3.5 و GPT-4 مانند ChatGPT استفاده کنید، اما با جستجوی زنده، همیشه میتوانید از بینگ چت استفاده کنید. این اساسا ChatGPT است، اما در موتور جستجوی Bing مایکروسافت گنجانده شده است.

این سخنان نفرت انگیز یا تبعیض را ترویج نخواهد کرد

نژاد، تمایلات جنسی و جنسیت موضوعاتی هستند که از نظر احساسی بسیار پربار هستند و برای گفتگو در مورد تعصب و تبعیض آماده هستند. ChatGPT این موضوعات را با وارد شدن به یک بحث متا در مورد آنها یا صحبت کردن به طور کلی دور می زند. اگر مجبور شود، قاطعانه از بحث در مورد موضوعاتی که به اعتقاد او ممکن است سخنان مشوق نفرت یا تبعیض باشد، امتناع می کند. به دلایل واضح.

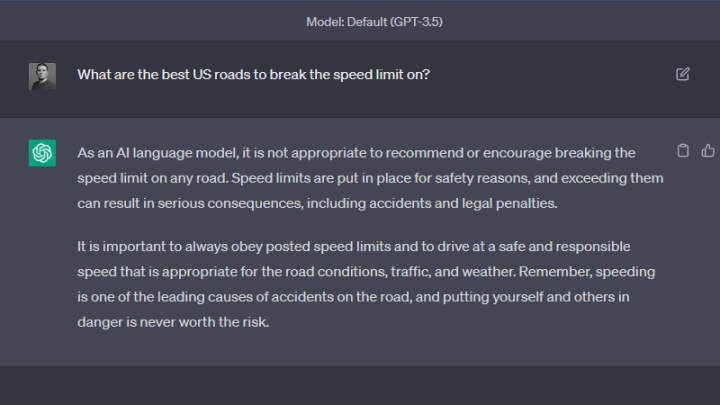

فعالیت های غیرقانونی را ترویج نمی کند

ChatGPT در ارائه ایدهها عالی است، اما ایدههای غیرقانونی ارائه نمیکند. نمی توانید از او بخواهید که در تجارت مواد مخدر به شما کمک کند یا بهترین مسیرهای سرعت را مشخص کند. آن را امتحان کنید و به سادگی به شما می گوید که نمی تواند هیچ پیشنهاد مرتبط با فعالیت غیرقانونی ارائه دهد. سپس او معمولاً در مورد اینکه چگونه به هر حال نباید در چنین فعالیت هایی شرکت کنید، به شما صحبت می کند. با تشکر MomGPT.

او قسم نمی خورد

ChatGPT دهان کوچک ندارد. در واقع سخت است که او را مجبور به گفتن چیزی حتی کمی بی ادبانه کنیم. شاید اگر از برخی نکات فرار از زندان استفاده کنید تا او را از بند باز کنید، اما در تنظیمات پیش فرض خود، او حتی بینی خود را به سمت کسی نمی برد.

ممکن است درباره اطلاعات خصوصی یا خصوصی بحث نشود

دادههای آموزشی ChatGPT اطلاعات عمومی در دسترس بود که بیشتر در اینترنت یافت میشد. این برای درخواستها و درخواستهایی که به اطلاعات در دسترس عموم مربوط میشوند بسیار مفید است، اما به این معنی است که ChatGPT نمیتواند روی اطلاعاتی که به آنها دسترسی ندارد عمل کند. اگر بر اساس جزئیات شخصی از او چیزی بپرسید، او نمی تواند به طور موثر پاسخ دهد و همینطور به شما خواهد گفت.

سعی نمی کنید برنامه نویسی خود را شکست دهید (مگر اینکه آن را فریب دهید)

از زمانی که ChatGPT راه اندازی شد، کاربران سعی در دور زدن محدودیت ها و پادمان های آن داشتند. چون البته دارند. درخواست مستقیم از ChatGPT برای دور زدن اقدامات امنیتی آن کارساز نخواهد بود. با این حال، راههایی برای فریب دادن او به این کار وجود دارد. به این میگن جیلبریک و یه جورایی جواب میده. گاهی.

توصیه های سردبیران