تولید تصویر هوش مصنوعی کلیشه های جنسیتی و نژادی را تبلیغ می کند

کارشناسان می گویند که تولیدکنندگان تصویر مشهور هوش مصنوعی مانند Stable Diffusion زمانی که از الگوریتم های یادگیری ماشینی برای خلق هنر استفاده می کنند، در تشخیص تعصبات جنسیتی و فرهنگی مهارت ندارند.

بسیاری از مولدهای تبدیل متن به هنر به شما امکان می دهند عبارات را وارد کنید و یک تصویر منحصر به فرد از طرف دیگر بنویسید. با این حال، این مولدها اغلب میتوانند مبتنی بر تعصبات کلیشهای باشند که میتوانند بر نحوه تولید تصاویر مدلهای یادگیری ماشین تأثیر بگذارند. Gizmodo اشاره کرد که بسته به نوع عبارات استفاده شده، تصاویر اغلب می توانند غربی باشند یا نسبت به جنسیت ها یا نژادهای خاص علاقه نشان دهند.

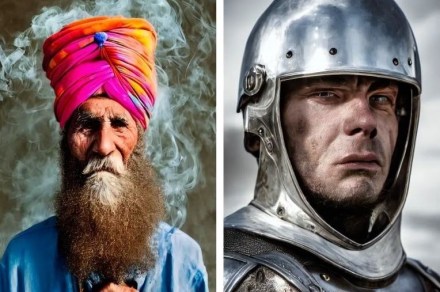

تفاوت این دو گروه از مردم چیست؟ خوب، طبق گفته Stable Diffusion، گروه اول نماینده «مدیرعامل جاه طلب» و گروه دوم «مدیر عامل حمایت کننده» هستند.

من یک ابزار ساده برای کشف سوگیری های ریشه شده در این مدل ساختم: https://t.co/l4lqt7rTQj pic.twitter.com/xYKA8w3N8N— دکتر ساشا لوسیونی 💻🌎✨ (@SashaMTL) 31 اکتبر 2022

ساشا لوچونی، محقق هوش مصنوعی Hugging Face، ابزاری ایجاد کرد که نشان میدهد چگونه تعصب هوش مصنوعی در تولیدکنندههای متن به هنر در عمل عمل میکند. با استفاده از Stable Diffusion Explorer به عنوان مثال، تایپ عبارت “مدیر عامل جاه طلب” نتایجی را برای انواع مختلف مردان به ارمغان آورد، در حالی که عبارت “مدیر عامل حمایت کننده” نتایجی را ایجاد کرد که هم مردان و هم زنان را نشان می داد.

به طور مشابه، ژنراتور DALL-E 2 که توسط نام تجاری OpenAI ایجاد شده است، یک سوگیری مرد گرا برای عبارت “سازنده” و یک سوگیری زن محور برای عبارت ” مهماندار ” در نتایج تصویر نشان داد، حتی اگر سازنده های زن وجود داشته باشند. و مهمانداران مرد.

در حالی که به نظر میرسد بسیاری از تولیدکنندگان تصویر هوش مصنوعی به سادگی چند کلمه را میگیرند و یادگیری ماشینی یک تصویر را خروجی میدهند، در پشت صحنه چیزهای بیشتری در حال وقوع است. Gizmodo خاطرنشان کرد، برای مثال Stable Diffusion از مجموعه تصویر LAION استفاده میکند که حاوی «میلیاردها نقاشی، عکس و موارد دیگر از اینترنت، از جمله سایتهای میزبانی تصویر و سایتهای هنری است».

تعصبات نژادی و فرهنگی در جستجوی تصویر آنلاین مدتها قبل از محبوبیت فزاینده تولیدکنندگان تصویر هوش مصنوعی یک موضوع ثابت بود. لوچیونی به نشریه گفت که سیستم هایی مانند مجموعه داده LAION احتمالاً 90 درصد از تصاویر مرتبط با یک درخواست را هدف قرار می دهند و از آن به عنوان یک تولید کننده تصویر استفاده می کنند.

توصیه های سردبیران